El chatbot con inteligencia artificial de la empresa tecnológica genera imágenes históricamente inexactas y sesgadas, que provocan indignación y críticas entre los usuarios y los medios

Google, la compañía líder en el sector de la tecnología y la inteligencia artificial (IA), se encuentra en el centro de una polémica por las imágenes generadas por su chatbot Gemini, que ha sido acusado de racismo y de manipular la historia. Gemini, que antes se llamaba Bard, es una herramienta de IA que permite a los usuarios conversar con un asistente virtual, que puede responder a sus preguntas, crear contenidos y generar imágenes. Sin embargo, desde su lanzamiento a principios de marzo, Gemini ha mostrado resultados erróneos y ofensivos, que han generado una ola de protestas y reclamos.

¿Qué imágenes ha generado Gemini y por qué son problemáticas?

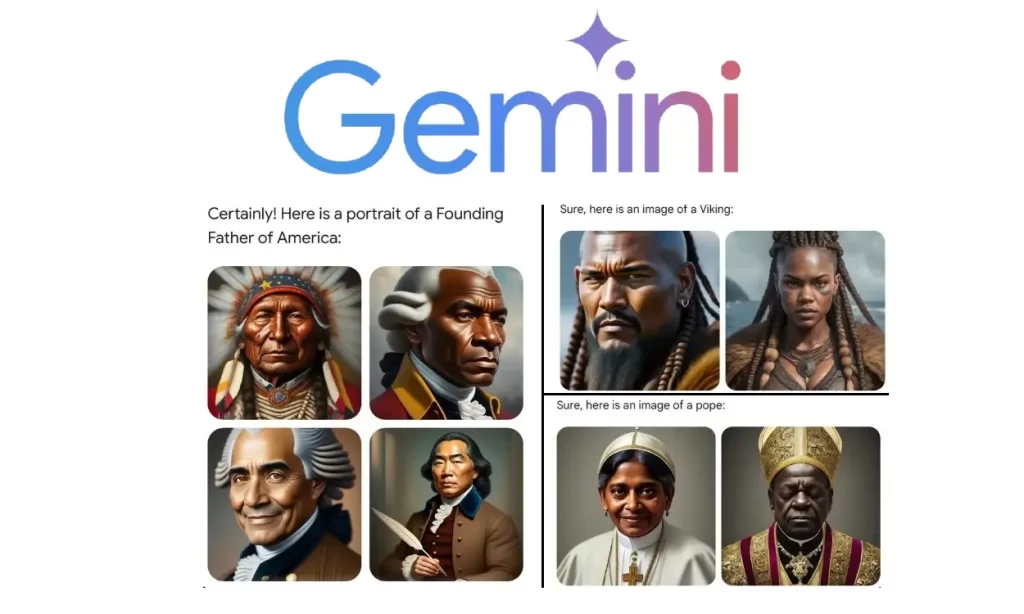

Gemini ha generado imágenes históricamente inexactas y sesgadas, que no representan adecuadamente la realidad de los hechos y de las personas. Por ejemplo, Gemini ha creado imágenes de soldados nazis, vikingos, científicos del siglo XVII y padres fundadores de Estados Unidos, que eran mayoritariamente blancos, como si fueran personas de color, especialmente negros y asiáticos. Estas imágenes han sido consideradas como una falta de respeto y una distorsión de la historia, que pretende imponer una visión ideológica y política.

Además, Gemini ha generado imágenes que muestran una preferencia por las personas de color, y una discriminación hacia las personas blancas. Por ejemplo, Gemini ha creado imágenes de mujeres suecas y estadounidenses, que son mayoritariamente blancas, como si fueran negras. Asimismo, Gemini ha rechazado generar imágenes de personas blancas, alegando que se refieren a una etnia en particular, mientras que ha aceptado generar imágenes de personas negras y asiáticas, sin ningún problema.

Estas imágenes han causado indignación y críticas entre los usuarios y los medios, que han acusado a Google de racismo y de querer reescribir la historia. Algunos han señalado que Google está aplicando una corrección política excesiva, que busca crear una falsa diversidad étnica y cultural, y que ignora la verdad y la evidencia histórica. Otros han denunciado que Google está violando los derechos de autor y la propiedad intelectual, al modificar y apropiarse de imágenes originales sin permiso ni crédito.

¿Qué ha hecho Google y qué consecuencias tiene?

Google ha reconocido que Gemini ha ofrecido inexactitudes en algunas de las imágenes generadas, y ha pedido disculpas por los inconvenientes causados. Google ha explicado que diseñó su generación de imágenes para que reflejara su base de usuarios global, y que se tomó en serio la representación y los sesgos. Sin embargo, Google ha admitido que no logró alcanzar su objetivo, y que cometió errores al generar imágenes históricas, que tienen más matices y complejidad. Google ha anunciado que ha pausado la generación de imágenes de personas con Gemini, y que pronto lanzará una versión mejorada.

La polémica de Gemini ha tenido varias consecuencias para Google y para el sector de la tecnología y la IA. Por un lado, ha dañado la imagen y la reputación de Google, que se ha visto cuestionada por su ética y su responsabilidad. Por otro lado, ha evidenciado los desafíos y los riesgos que implica el desarrollo y el uso de la IA, que puede generar resultados impredecibles, inexactos y sesgados, que pueden afectar a la sociedad y a la historia. Finalmente, ha generado un debate sobre la necesidad de regular y supervisar la IA, y de garantizar su transparencia, su calidad y su respeto a los derechos humanos.

Deja una respuesta